llama(服务器端)CLI 参考

llama CLI 工具可帮助您设置和使用 Llama Stack。安装 llama-stack 包后,CLI 即可在您的路径中使用。

安装

您可以通过两种方式安装 Llama Stack

作为包安装: 您可以通过运行以下命令直接从 PyPI 安装仓库

pip install llama-stack

从源码安装: 如果您更喜欢从源代码安装,请按照以下步骤操作

mkdir -p ~/local cd ~/local git clone git@github.com:meta-llama/llama-stack.git conda create -n myenv python=3.10 conda activate myenv cd llama-stack $CONDA_PREFIX/bin/pip install -e .

llama 子命令

download: 支持从 Meta 或 Hugging Face 下载模型。 下载模型model: 列出可用模型及其属性。 理解模型stack: 允许您使用llama stack分发构建一个 stack 并运行 Llama Stack 服务器。您可以在构建自己的分发文档中阅读有关如何构建 Llama Stack 分发的更多信息。

示例用法

llama --help

usage: llama [-h] {download,model,stack} ...

Welcome to the Llama CLI

options:

-h, --help show this help message and exit

subcommands:

{download,model,stack}

下载模型

您首先需要在本地下载模型。

要下载任何模型,您需要模型描述符。这可以通过运行以下命令获得

llama model list

您应该会看到如下表格

+----------------------------------+------------------------------------------+----------------+

| Model Descriptor(ID) | Hugging Face Repo | Context Length |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-8B | meta-llama/Llama-3.1-8B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-70B | meta-llama/Llama-3.1-70B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B:bf16-mp8 | meta-llama/Llama-3.1-405B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B | meta-llama/Llama-3.1-405B-FP8 | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B:bf16-mp16 | meta-llama/Llama-3.1-405B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-8B-Instruct | meta-llama/Llama-3.1-8B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-70B-Instruct | meta-llama/Llama-3.1-70B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B-Instruct:bf16-mp8 | meta-llama/Llama-3.1-405B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B-Instruct | meta-llama/Llama-3.1-405B-Instruct-FP8 | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.1-405B-Instruct:bf16-mp16 | meta-llama/Llama-3.1-405B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-1B | meta-llama/Llama-3.2-1B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-3B | meta-llama/Llama-3.2-3B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-11B-Vision | meta-llama/Llama-3.2-11B-Vision | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-90B-Vision | meta-llama/Llama-3.2-90B-Vision | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-1B-Instruct | meta-llama/Llama-3.2-1B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-3B-Instruct | meta-llama/Llama-3.2-3B-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-11B-Vision-Instruct | meta-llama/Llama-3.2-11B-Vision-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama3.2-90B-Vision-Instruct | meta-llama/Llama-3.2-90B-Vision-Instruct | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-3-11B-Vision | meta-llama/Llama-Guard-3-11B-Vision | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-3-1B:int4-mp1 | meta-llama/Llama-Guard-3-1B-INT4 | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-3-1B | meta-llama/Llama-Guard-3-1B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-3-8B | meta-llama/Llama-Guard-3-8B | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-3-8B:int8-mp1 | meta-llama/Llama-Guard-3-8B-INT8 | 128K |

+----------------------------------+------------------------------------------+----------------+

| Prompt-Guard-86M | meta-llama/Prompt-Guard-86M | 128K |

+----------------------------------+------------------------------------------+----------------+

| Llama-Guard-2-8B | meta-llama/Llama-Guard-2-8B | 4K |

+----------------------------------+------------------------------------------+----------------+

要下载模型,您可以使用 llama download 命令。

从 Meta 下载

这里是一个示例下载命令,用于获取 3B-Instruct/11B-Vision-Instruct 模型。您需要 META_URL,可以从此处获取

使用以下命令下载所需的检查点

# download the 8B model, this can be run on a single GPU

llama download --source meta --model-id Llama3.2-3B-Instruct --meta-url META_URL

# you can also get the 70B model, this will require 8 GPUs however

llama download --source meta --model-id Llama3.2-11B-Vision-Instruct --meta-url META_URL

# llama-agents have safety enabled by default. For this, you will need

# safety models -- Llama-Guard and Prompt-Guard

llama download --source meta --model-id Prompt-Guard-86M --meta-url META_URL

llama download --source meta --model-id Llama-Guard-3-1B --meta-url META_URL

从 Hugging Face 下载

本质上,上面的命令仍然适用,只需将 --source meta 替换为 --source huggingface 即可。

llama download --source huggingface --model-id Llama3.1-8B-Instruct --hf-token <HF_TOKEN>

llama download --source huggingface --model-id Llama3.1-70B-Instruct --hf-token <HF_TOKEN>

llama download --source huggingface --model-id Llama-Guard-3-1B --ignore-patterns *original*

llama download --source huggingface --model-id Prompt-Guard-86M --ignore-patterns *original*

重要提示:设置环境变量 HF_TOKEN 或将 --hf-token 参数传递给命令以验证您的访问权限。您可以在 https://hugging-face.cn/settings/tokens 找到您的 token。

提示:

llama download的默认行为是运行--ignore-patterns *.safetensors,因为我们在original文件夹中使用.pth文件。但是,对于 Llama Guard 和 Prompt Guard,我们需要 safetensors。因此,请使用--ignore-patterns original运行,以便下载 safetensors 并忽略.pth文件。

列出已下载模型

使用以下命令列出已下载的模型

llama model list --downloaded

您应该会看到如下表格

┏━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━┳━━━━━━━━━━┳━━━━━━━━━━━━━━━━━━━━━┓

┃ Model ┃ Size ┃ Modified Time ┃

┡━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━╇━━━━━━━━━━╇━━━━━━━━━━━━━━━━━━━━━┩

│ Llama3.2-1B-Instruct:int4-qlora-eo8 │ 1.53 GB │ 2025-02-26 11:22:28 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama3.2-1B │ 2.31 GB │ 2025-02-18 21:48:52 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Prompt-Guard-86M │ 0.02 GB │ 2025-02-26 11:29:28 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama3.2-3B-Instruct:int4-spinquant-eo8 │ 3.69 GB │ 2025-02-26 11:37:41 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama3.2-3B │ 5.99 GB │ 2025-02-18 21:51:26 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama3.1-8B │ 14.97 GB │ 2025-02-16 10:36:37 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama3.2-1B-Instruct:int4-spinquant-eo8 │ 1.51 GB │ 2025-02-26 11:35:02 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama-Guard-3-1B │ 2.80 GB │ 2025-02-26 11:20:46 │

├─────────────────────────────────────────┼──────────┼─────────────────────┤

│ Llama-Guard-3-1B:int4 │ 0.43 GB │ 2025-02-26 11:33:33 │

└─────────────────────────────────────────┴──────────┴─────────────────────┘

理解模型

llama model 命令可帮助您探索模型的接口。

download: 从不同来源下载模型。(meta, huggingface)list: 列出所有可供下载的模型以及部署这些模型的硬件要求。prompt-format: 显示 llama 模型消息格式。describe: 描述模型的所有属性。

示例用法

llama model <subcommand> <options>

llama model --help

usage: llama model [-h] {download,list,prompt-format,describe,verify-download,remove} ...

Work with llama models

options:

-h, --help show this help message and exit

model_subcommands:

{download,list,prompt-format,describe,verify-download,remove}

描述

您可以使用 describe 命令了解有关模型的更多信息

llama model describe -m Llama3.2-3B-Instruct

+-----------------------------+----------------------------------+

| Model | Llama3.2-3B-Instruct |

+-----------------------------+----------------------------------+

| Hugging Face ID | meta-llama/Llama-3.2-3B-Instruct |

+-----------------------------+----------------------------------+

| Description | Llama 3.2 3b instruct model |

+-----------------------------+----------------------------------+

| Context Length | 128K tokens |

+-----------------------------+----------------------------------+

| Weights format | bf16 |

+-----------------------------+----------------------------------+

| Model params.json | { |

| | "dim": 3072, |

| | "n_layers": 28, |

| | "n_heads": 24, |

| | "n_kv_heads": 8, |

| | "vocab_size": 128256, |

| | "ffn_dim_multiplier": 1.0, |

| | "multiple_of": 256, |

| | "norm_eps": 1e-05, |

| | "rope_theta": 500000.0, |

| | "use_scaled_rope": true |

| | } |

+-----------------------------+----------------------------------+

| Recommended sampling params | { |

| | "temperature": 1.0, |

| | "top_p": 0.9, |

| | "top_k": 0 |

| | } |

+-----------------------------+----------------------------------+

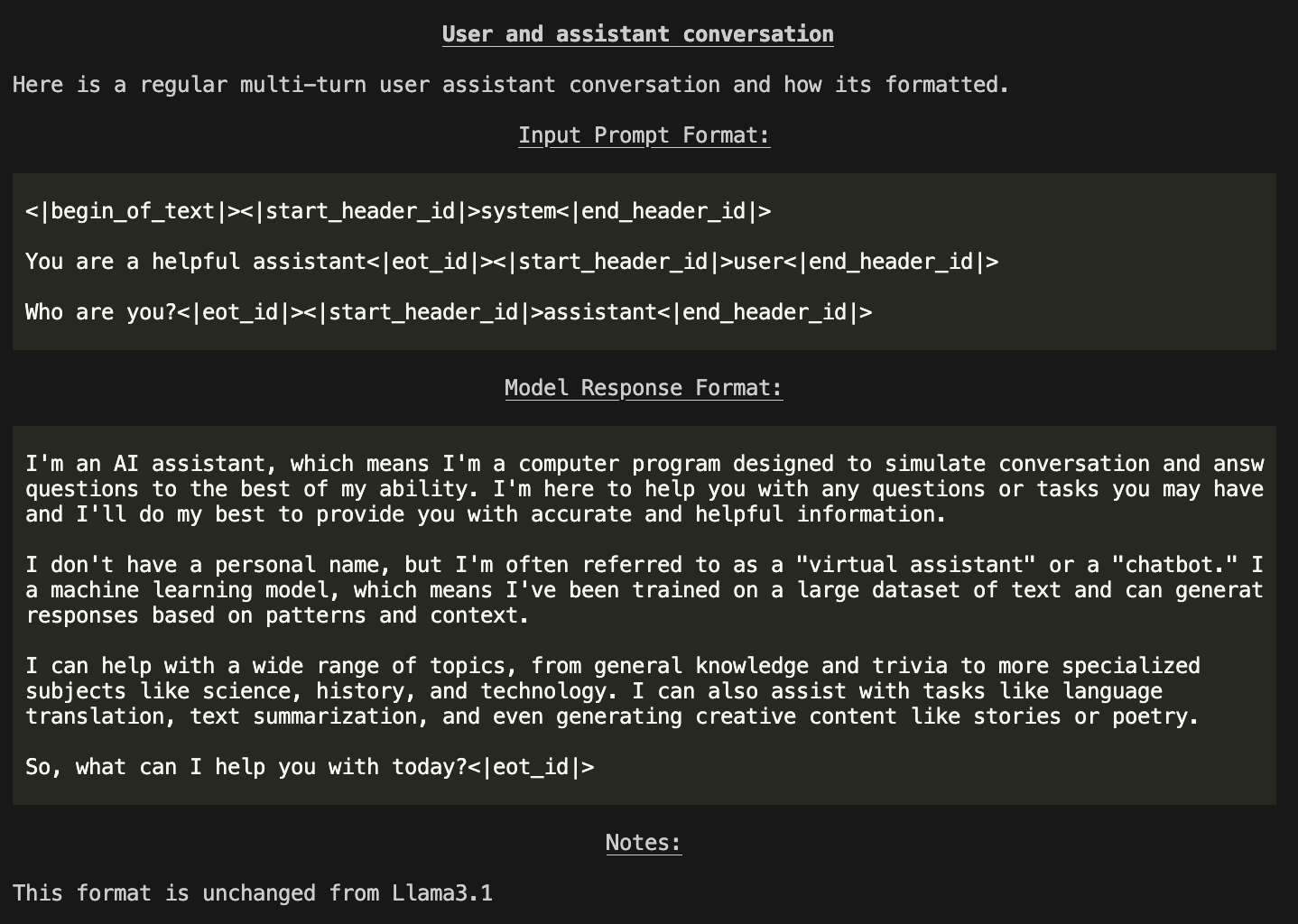

Prompt 格式

您甚至可以运行 llama model prompt-format 查看所有模板及其 token

llama model prompt-format -m Llama3.2-3B-Instruct

将向您显示模型接口的 Markdown 格式描述,以及针对各种场景如何格式化 prompt/消息。

注意:终端中的输出会以彩色打印以显示特殊 token。

删除模型

您可以运行 llama model remove 删除不需要的模型

llama model remove -m Llama-Guard-3-8B-int8